私たちは、PyTorch 何ができるのかを深く探求し、この人気のあるフレームワークが機械学習と深層学習にどのように役立つかを理解します。PyTorchは、研究者やエンジニアにとって非常に有用なツールであり、その柔軟性と使いやすさから多くのプロジェクトで採用されています。

この記事では、PyTorchを使用して実現できる具体的な活用法やメリットについて詳しく解説します。データ解析からニューラルネットワークの構築まで幅広い用途があります。私たちも皆さんと一緒にその魅力を発見し新しい知識を得ましょう。この強力なツールのおかげで、どんな革新的なアイデアが生まれるのでしょうか?興味が湧いてきましたね。

PyTorch 何ができる?基本機能と特長

PyTorchは、機械学習や深層学習の分野で強力なツールとして広く利用されています。その柔軟性と使いやすさにより、研究者や開発者が様々なモデルを迅速に構築し、実験することが可能です。ここでは、PyTorchの基本的な機能と特長について詳しく見ていきましょう。

テンソル操作

PyTorchの中心となる要素は「テンソル」です。これは多次元配列であり、NumPyの配列に似た構造を持ちながらも、GPUによる計算をサポートしています。これにより、大規模データセットの処理が飛躍的に向上します。

- 自動微分: PyTorchは、自動微分機能を備えており、勾配計算を簡単に行うことができます。この点は機械学習アルゴリズムのトレーニングプロセスで非常に重要です。

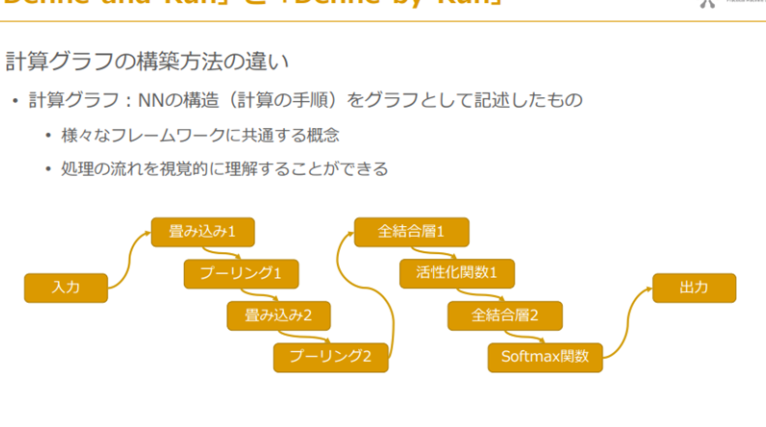

- ダイナミックコンピュテーショングラフ: 実行時にグラフを生成・変更できるため、モデル構築やデバッグが容易になります。これにより、小さな修正でも即座に結果を確認できます。

モデル構築

PyTorchでは、高度なニューラルネットワークモデルを簡単かつ直感的に定義できます。「nn.Module」を使用することで、複雑なアーキテクチャもシンプルなコードで表現可能です。例えば:

import torch.nn as nn

class NeuralNet(nn.Module):

def __init__(self):

super(NeuralNet, self).__init__()

self.fc1 = nn.Linear(10, 5)

self.fc2 = nn.Linear(5, 2)

def forward(self, x):

x = self.fc1(x)

return self.fc2(x)このようにして作成したモデルは、その後容易にトレーニングや評価へと進めます。

コミュニティとエコシステム

PyTorchには活発なコミュニティが存在し、多くのリソースやライブラリがあります。このエコシステムには以下のようなものがあります:

- torchvision: コンピュータビジョン関連のタスク用ライブラリ。

- torchaudio: 音声処理用ライブラリ。

- torchtext: 自然言語処理用ライブラリ。

これらのツールを利用することで、多様なデータタイプへの対応能力が高まり、更なる研究開発が促進されます。

以上からもわかるように、「pytorch 何ができる」かという疑問には、多岐にわたる機能と利用方法があります。それぞれ特長的でありながら相互補完的でもあるため、新しいアイディアやプロジェクトにも積極的につながります。

機械学習におけるPyTorchの活用法

私たちが機械学習においてPyTorchをどのように活用できるかは、非常に多様なアプローチがあります。特に、データの準備からモデルのトレーニング、評価まで、一貫したワークフローを提供するため、多くの研究者や開発者に支持されています。このセクションでは、具体的な活用法について詳しく見ていきましょう。

データ前処理と変換

機械学習モデルのパフォーマンスは、入力データの質によって大きく左右されます。PyTorchでは、torchvision.transformsなどのライブラリを使用して画像データを簡単に前処理できます。また、音声やテキストデータの場合も、それぞれ専用のライブラリが利用可能です。以下は一般的な前処理手法です:

- ノーマライゼーション: データを特定の範囲にスケーリングし、一貫性を持たせます。

- データ拡張: 学習時にはランダムな回転や反転などでデータセットを増強します。

- バッチ処理: 大量のデータを効率よく扱うため、小さなバッチ単位でモデルへ供給します。

モデル設計とカスタマイズ

PyTorchでは、自分自身で新しいアーキテクチャを設計することが容易です。我々は「nn.Module」を基に独自のモデルを作成し、それらを組み合わせて複雑なネットワーク構造にも対応できます。例えば、自動車画像認識タスクでは以下のようになります:

import torch.nn as nn

class CarClassifier(nn.Module):

def __init__(self):

super(CarClassifier, self).__init__()

self.conv1 = nn.Conv2d(3, 16, kernel_size=3, padding=1)

self.pool = nn.MaxPool2d(kernel_size=2, stride=2)

self.fc1 = nn.Linear(16 * 16 * 16, 128)

def forward(self, x):

x = self.pool(F.relu(self.conv1(x)))

x = x.view(-1, 16 * 16 * 16)

return F.log_softmax(self.fc1(x), dim=1)このような柔軟性のおかげで、新しいアイディアやアルゴリズムも迅速に試すことが可能となります。

トレーニング戦略

トレーニングプロセスは成功への鍵です。PyTorchでは、高度なオプティマイザや損失関数が揃っており、お好みに応じた最適化方法が選択可能です。また、自動微分機能によって勾配計算も自動化されるため、エラー修正やパラメーター調整も簡単になります。ここで考慮すべきポイントは次の通りです:

- 早期停止: 過学習防止ため一定条件下でトレーニング終了。

- 学習率調整: 動的に学習率変更することで効率向上。

- クロスバリデーション: モデル評価精度向上への助けとなります。

これら全てが統合されることで、「pytorch 何ができる」の質問には明確な答えがあります。それぞれ異なる側面から機械学習プロジェクトへ寄与し、更なる革新につながるでしょう。

深層学習モデルの構築とトレーニング

は、私たちがPyTorchを通じて活用できる大きな利点の一つです。特に、複雑なデータセットやタスクに対して高いパフォーマンスを発揮するため、柔軟で効率的な方法が求められています。このセクションでは、深層学習モデルの設計からトレーニングまでのプロセスを詳しく解説します。

モデルアーキテクチャの選定

深層学習においては、適切なモデルアーキテクチャの選択が成功への鍵となります。PyTorchでは、多様なプリビルトモデルやカスタムネットワークを容易に実装できます。以下は一般的なアーキテクチャタイプです:

- 畳み込みニューラルネットワーク(CNN): 画像認識や分類タスクに広く使用されます。

- 再帰型ニューラルネットワーク(RNN): 時系列データや自然言語処理タスクで効果的です。

- 生成逆転ネットワーク(GAN): 新しいデータサンプルを生成するために利用されます。

これらのアーキテクチャは、それぞれ異なる特性を持っており、目的によって最適なものを選ぶことが重要です。

トレーニングプロセスの詳細

モデルのトレーニングには多くの要素が絡み合います。例えば、損失関数やオプティマイザなどがあります。また、自動微分機能によって勾配計算も簡単になり、我々はより迅速かつ正確にパラメータ調整やエラー修正が可能になります。主なポイントとして以下があります:

- バッチサイズ設定: モデル更新時、一度に処理するサンプル数を決定します。

- エポック数: データセット全体で何回訓練するかを指定します。

- L2正則化: 過学習防止策として有効です。

Pytorch 何ができるという観点から見ると、このような詳細設定も含めて我々は多様な手法で深層学習モデルを効果的に構築し、その性能を最大限引き出すことができます。

評価と改善戦略

Pytorchでは、トレーニング後のモデル評価も重要です。この段階では以下の方法で性能向上策を講じることが可能です:

- Kappa係数: 分類精度だけでなく、一致率も考慮した指標になります。

- AUC-ROC曲線: モデル判別能力を見るため有効です。

- MSE損失関数: 回帰問題の場合、高精度化につながります。

Pytorch 何ができるかについて理解することで、新しいアイディアや技術革新へ繋げられるでしょう。我々はこのフレームワークによって複雑さと柔軟性両方を享受しながら、高品質な深層学習ソリューションへの道筋を拓けます。

データ処理と前処理の手法

データ処理と前処理は、機械学習や深層学習モデルのパフォーマンスを向上させるために不可欠なステップです。特にPyTorchでは、これらのプロセスを効率的に行うためのツールとライブラリが豊富に提供されています。このセクションでは、データ処理および前処理の手法について詳しく説明し、それぞれの重要性を理解していきます。

データクリーニング

データクリーニングは、モデルが正確な予測を行うためには必須です。不完全なデータや異常値が含まれている場合、結果は大きく歪む可能性があります。以下は一般的なデータクリーニング手法です:

- 欠損値処理: 欠損値は削除するか、平均や中央値で置換します。

- 外れ値検出: 箱ひげ図やZスコアなどで外れ値を特定し、適切に対処します。

- 重複データ削除: 同一サンプルが複数存在する場合、それを排除します。

Pytorch 何ができるという観点から見ると、この段階で正確かつ信頼性の高い訓練用データセットを構築することが可能になります。

特徴量エンジニアリング

特徴量エンジニアリングとは、生のデータから有用な情報を抽出し、新たな特徴量を生成するプロセスです。これはモデルの性能向上につながります。主な手法として以下があります:

- カテゴリ変数のエンコーディング: ラベルエンコーディングやワンホットエンコーディングによってカテゴリ変数を数値化します。

- 標準化および正規化: 特徴量間でスケールを揃えることで、モデル学習時のバイアスを軽減します。

- PCA(主成分分析): 次元削減技術であり、多次元空間内で重要な情報だけを残すことができます。

Pytorch 何ができるという視点から、このように適切に特徴量を選定・変換することで、我々はより優れたパフォーマンスと解釈力あるモデル構築へと導くことができます。

データ拡張技術

Pytorchでは、限られたトレーニングデータでも効果的に学習できるようにするため、多様なデータ拡張技術も利用できます。この技術によって新しいサンプルが生成され、多様性が増すことで過学習防止にも寄与します。一部の代表例として:

- Augmentation: 画像回転やフリップなどによって画像データセットサイズを増加させます。

- Noise Addition: データにノイズを追加して汎化能力向上につながります。

Pytorch 何ができるという観点から、このような拡張手法によって私たちは限られた資源でも高品質かつ多様性豊かな訓練環境を整えることが可能となります。これによって最終的には深層学習モデル全体の精度改善へ繋げていけます。

コミュニティとリソースの活用方法

私たちがPyTorchを活用する上で、コミュニティやリソースの存在は非常に重要です。特に機械学習や深層学習の分野では、情報共有やサポートが不可欠です。PyTorchのオープンソースコミュニティは活発で、多くの開発者や研究者が参加しており、それぞれの経験や知識をもとに貴重な情報を提供しています。このセクションでは、私たちがどのようにこれらのリソースを最大限に活用できるかについて考えていきます。

公式ドキュメントとチュートリアル

まず最初に、PyTorchには充実した公式ドキュメントがあります。このドキュメントには基本的な使い方から高度なテクニックまで、多岐にわたる情報が網羅されています。また、実践的なチュートリアルも多数掲載されており、自分自身で手を動かしながら学ぶことができます。以下は公式リソースの一部です:

- APIリファレンス: 各モジュールや関数について詳細な説明があります。

- 入門チュートリアル: PyTorchを使った簡単なプロジェクトから始めることができます。

- ケーススタディ: 実際のアプリケーション例として参考になります。

このようなリソースを利用することで、私たちは「pytorch 何ができる」の理解を深め、その能力を最大限引き出すことが可能です。

フォーラムとSNSグループ

次に、フォーラムやSNSグループも有効な情報源です。特定の問題解決や最新トレンドについて意見交換できる場として活用できます。PyTorch関連のフォーラムには、多くの専門家や愛好者がおり、質問すれば迅速な回答を得られることも少なくありません。一部おすすめプラットフォームは以下です:

- Stack Overflow: 特定技術的問題について多くのQ&Aがあります。

- Pytorch公式フォーラム: 開発者との直接対話が可能です。

- Tweet: Twitter上でハッシュタグ #Pytorch を追うことで最新情報収集.

こうしたオンラインコミュニティへの参加によって、新しいアイデアやアプローチ方法にも触れることができ、「pytorch 何ができる」をさらに広げていけるでしょう。

オープンソースプロジェクトとGitHub

最後に、GitHubなどで公開されているオープンソースプロジェクトは、自分自身でコードを書いたり、新しい技術を試すための素晴らしい資源となります。他人によって構築されたモデルを見ることで、それぞれ独自性豊かな解決策へアクセスできます。また、自分自身でも貢献することで新たな視点も得られます。

| リポジトリ名 | Description | スター数 |

|---|---|---|

| Pytorch Examples | Pytorch使用例集, 様々なタスク対応. | 10K+ |

| PyTorch Lightning | Pytorchワークフロー改善ツール. | 20K+ |

| TorchVision | CNN向け画像処理ライブラリ. | 30K+ |

このように多様なオープンソースプロジェクトへの関与は、「pytorch 何ができる」に対する理解だけでなく、自身의成長にもつながります。我々はこれら全てを駆使してより効果的かつ革新的なモデル構築へと取り組んでいけます。